Las pruebas están hechas con un Slimbook Excalibur AMD Ryzen 7 7840HS w/ Radeon 780M Graphics × 8 - 64 GB RAM y 1 TB nvme dedicado para este menester.

1) Instalar un gestor de modelos

Un gestor de modelos es una aplicación que nos permite descargar modelos para después poder ejecutar los modelos.Voy a instalar Ollama porque es el más conocido

Ollama es una aplicación que permite:

- Descargar modelos de lenguaje preentrenados

- Ejecutarlos en tu máquina (CPU/GPU)

- Gestionarlos (versiones, parámetros, etc.)

- Exponerlos mediante API local

- Usarlos como si fueran un servicio tipo ChatGPT

Instalarlo es muy sencillo desde Linux o Mac, en Windows seguramente se pueda hacer con WSL2 o con docker.

Como ya os habréis dado cuenta hay dos formas de instalarlo nativo en el servidor o con docker, en este ejemplo lo haremos nativo porque queremos la mayor rapidez posible.

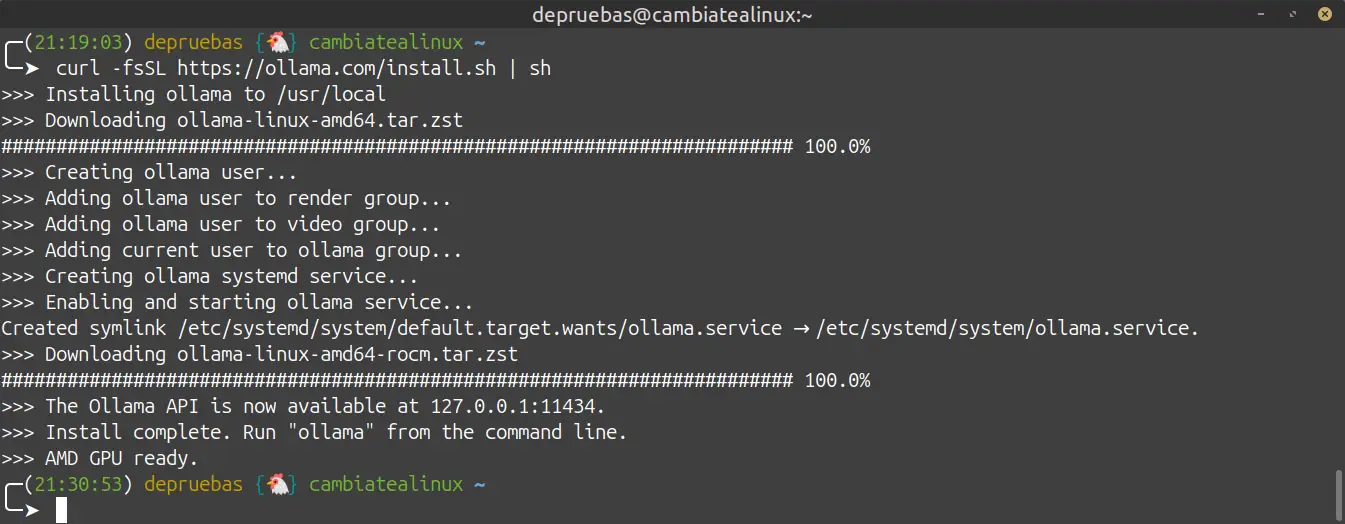

Para instalarlo desde el terminal usamos esta instrucción

curl -fsSL https://ollama.com/install.sh | sh

Esto, instala ollama pero no instala ningún modelo, para instalar modelos hay que descargarlos.

2) Descargar e instalar modelos

¿ Y qué modelos hay ? pues se pueden encontrar en esta dirección https://ollama.com/libraryAhora elegimos instalar el que mejor se adapte a nuestros requisitos, en mi caso voy a instalar varios modelos.

Voy a instalar los siguientes modelos.

- Deepseek-coder:6.7b

- llama3.1:8b

- qwen2.5-coder:14b

ollama pull deepseek-coder:6.7b

ollama pull llama3.1:8b

ollama pull qwen2.5-coder:14b

ollama help

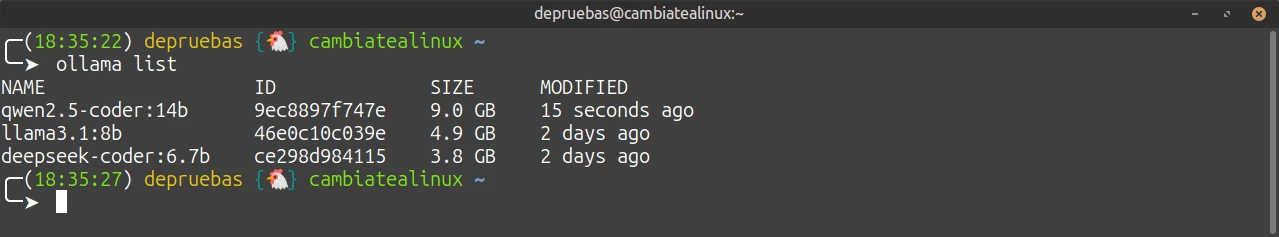

Podemos ver los parámetros que tiene ollama.Con el parámetro list

ollama list

podemos ver los modelos que tenemos instalados y que ocupa en disco cada modelo.

Ahora toca probarlo y desde el terminal podemos ejecutar el siguiente comando haciendo una petición a llama3.1:8b, el modelo se ha de poner completo con sus parámetros.

curl http://localhost:11434/api/generate -d '{

"model": "llama3.1:8b",

"prompt": "Dame un ejemplo de consulta SQL con JOIN y explícamela.",

"stream": false

}'

3) Instalar un entorno web para trabajar

Como ya habéis visto podemos trabajar con los modelos desde la consola para realizar peticiones.Esto funciona perfecto si somo desarrolladores y queremos integra el modelo en nuestro código pero seamos sinceros hablar con el modelo desde el terminal es un poco tedioso así que vamos a instalar un entorno web al estilo ChatGPT

Para Ollama instalaremos Open WebUI que es uno de los entorno más sencillos y similar a los que ya conocemos.

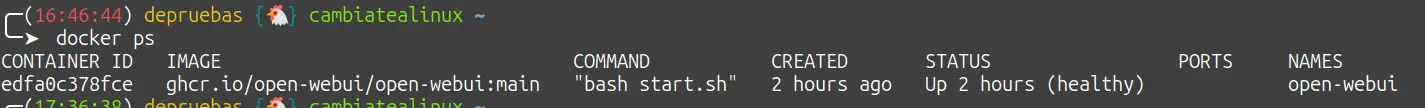

La instalación es muy sencilla y se realiza con docker, si no tenéis docker revisar este artículo https://www.netveloper.com/instalar-docker-en-linux

docker run -d \

--network=host \

-e OLLAMA_BASE_URL=http://127.0.0.1:11434 \

-e OLLAMA_API_BASE=http://127.0.0.1:11434 \

-v open-webui:/app/backend/data \

--name open-webui \

--restart always \

ghcr.io/open-webui/open-webui:main

Y podemos acceder al entorno web con la url:

http://localhost:8080

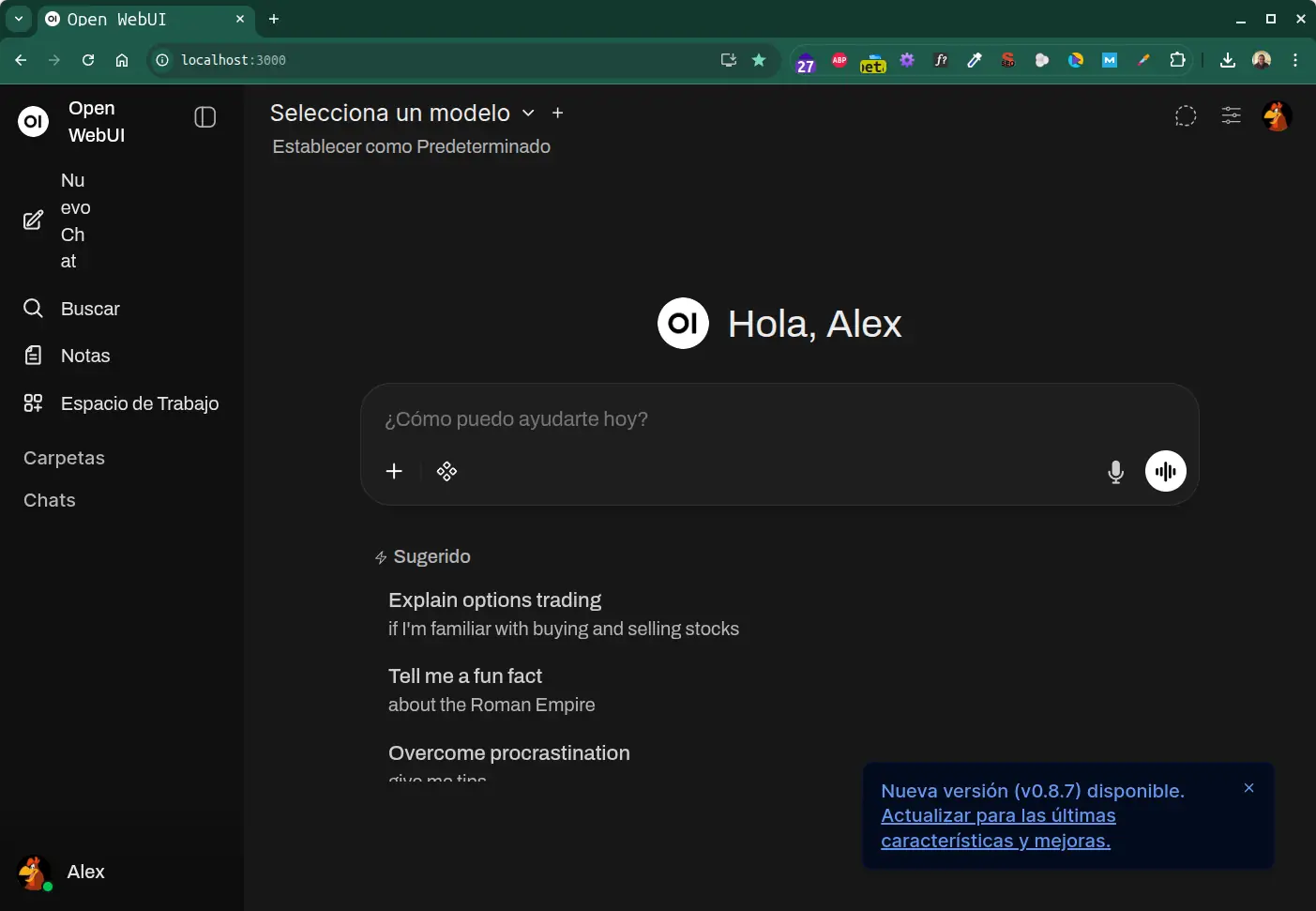

Pedirá crear una cuenta con email y password y se accede al entorno de trabajo

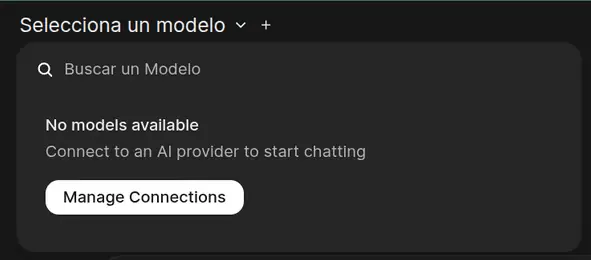

Ahora hay que ver si detecta bien los modelos pulsando en “Selecciona un modelo”

Si no salen modelos y sale esto:

Es que Ollama y Open-WebUi no conectan bien.

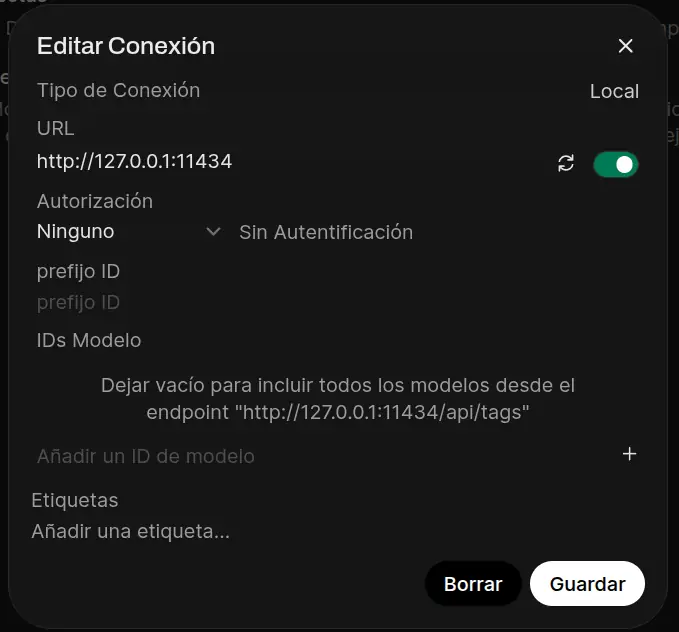

Hay que revisar las conexiones "Manage Connections" y tiene que quedar así:

El endpoint tiene que ser http://127.0.0.1:11434

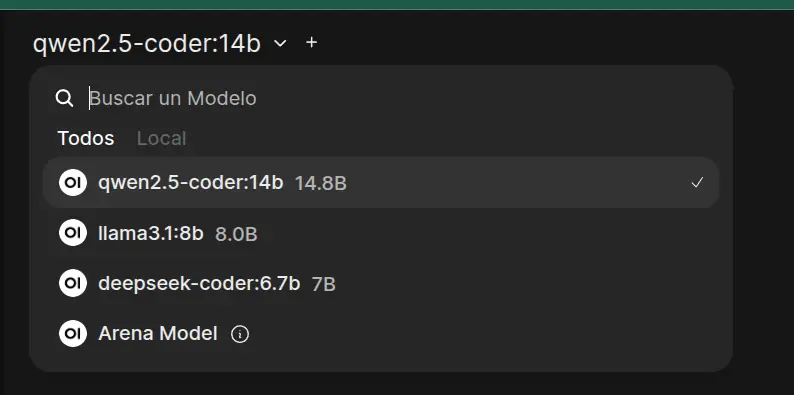

Al desplegar los modelos sale la lista para elegir el que mas nos guste

Arena Model es un modelo de webui especial de Open WebUI para comparar vários modelos de IA simultáneamente.

4) Conclusion

Es una buena solución tenerlos instalados en local para tener la mayor privacidad pero siempre y cuando tengas una buena máquina, potente y con GPU.Otra opción es tener un servidor en internet, la instalación es muy similar y se pueden alquilar servidores muy potentes.

Para mi, con mi portátil no es una opción viable porque no tiene un buen rendimiento. Se puede instalar, probar y jugar pero no para trabajar.

Y esto es todo amigos!!

Gracias por seguirme y leerme, espero que les haya ayudado

Saludos

Alex.